01 Novembro 2025

Bots de inteligência artificial podem aliviar a solidão, mas também podem isolar e criar dependência. A OpenAI reconhece milhões de consultas sobre suicídio no ChatGPT.

A reportagem é de Constança Cabrera, publicada por El País, 28-10-2025.

De assistentes virtuais capazes de detectar tristeza em vozes a bots projetados para simular o calor de um vínculo, a inteligência artificial (IA) está cruzando uma fronteira mais íntima. O fervor em torno da IA avança em um leito cada vez mais denso de perguntas que ninguém ainda respondeu. E embora tenha o potencial de reduzir a burocracia ou prever doenças, modelos de linguagem de grande porte (LLMs) treinados com dados em múltiplos formatos — texto, imagem e fala — são capazes de algo mais perturbador: eles podem se comportar como se entendessem os sentimentos humanos.

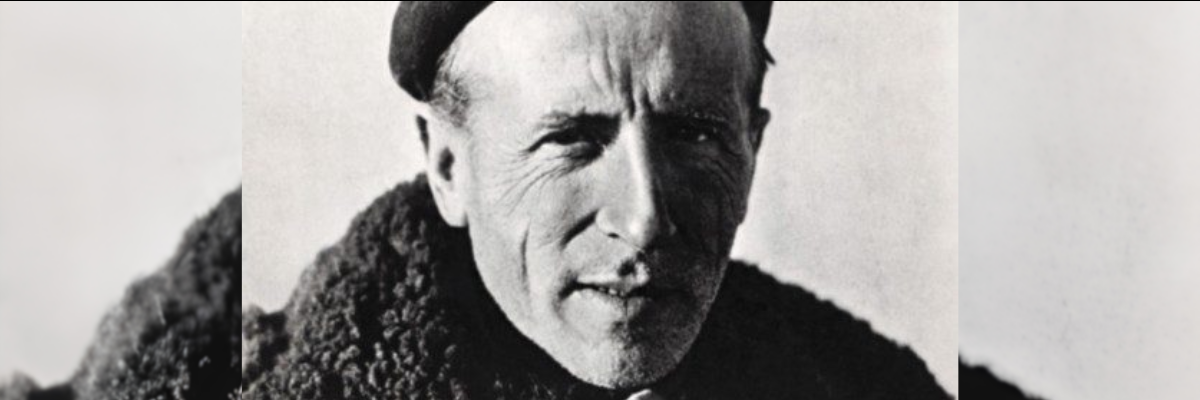

Perceber e ler emoções é uma área complexa para a IA. Diversos estudos indicam que os chats de IA podem aliviar a solidão, mas também podem isolar e criar dependência. Um caso extremo é o de Stein-Erik Soelberg, de 56 anos, que acabou matando a mãe e a si mesmo após meses de conversas com o ChatGPT. Na noite passada, a empresa OpenAI reconheceu que mais de um milhão de pessoas conversam com o ChatGPT sobre suicídio todas as semanas.

Não se trata mais apenas de discutir se as máquinas podem automatizar tarefas, mas também até que ponto elas estão começando a se infiltrar em áreas críticas como emoções, identidade e até mesmo a liberdade de expressão, que estão sendo gradualmente afetadas pelos algoritmos. Daniel Innerarity, professor de Filosofia Política e Social da Universidade do País Basco, acredita que a humanidade está vivendo um hype, ou seja, um momento de forte (e talvez exagerada) expectativa.

“Eu chamo isso de história digital. Há grandes expectativas e medos paralelos. Estamos oscilando entre esses dois extremos em uma curva ascendente acelerada”, diz esta especialista. Karen Vergara, pesquisadora de sociedade, tecnologia e gênero da ONG Amaranta (Chile), compartilha uma opinião semelhante. “Estamos em um processo de adaptação e reconhecimento desses avanços tecnológicos e socioculturais”, observa ela, mas acrescenta uma nuance importante. Porque enquanto uma parte da sociedade incorpora essa tecnologia em seu cotidiano, outra fica de fora. Pessoas para as quais a IA não é uma prioridade, presas em contextos precários e atravessadas por brechas de acesso que permanecem abertas.

A grande questão não é o quão sofisticada essa tecnologia, desenvolvida no século passado, pode ser para revelar padrões de comportamento, mas sim o nível de confiança depositado nela. Um estudo recente do MIT Media Lab, nos Estados Unidos, identificou padrões de interação entre usuários que variam de indivíduos "socialmente vulneráveis" com intensos sentimentos de solidão a aqueles altamente dependentes de tecnologia, com forte conexão emocional, e usuários "casuais", que usam a IA de forma mais equilibrada.

Para Innerarity, a ideia de que alguém cometeu suicídio porque "um algoritmo o recomendou" nos remete a uma questão anterior: o que se passa na mente de uma pessoa que decide confiar em uma máquina em vez de um humano. "Certamente o problema é anterior", enfatiza este filósofo.

A sociedade, diz Innerarity, cometeu um erro enorme ao antropomorfizar a IA. "Quando escrevi Uma Teoria Crítica da Inteligência Artificial (Galaxia Gutenberg, 2025), tive que encontrar uma capa, e a única coisa que eu tinha certeza era que não queria colocar um robô com forma humana", lembra ele. Ele é totalmente contra representações de IA com mãos, pés e cabeça: "Noventa e nove por cento dos robôs que nós, humanos, usamos, não têm forma antropomórfica."

Um oráculo digital que reproduz preconceitos

Mercedes Siles, professora de Álgebra na Universidade de Málaga e membro do Conselho Consultivo da Fundação Hermès, propõe uma imagem simples. Uma metáfora. Ela nos pede para imaginar a IA como uma pequena caixa cheia de papéis dobrados. Algo como uma versão menos crocante dos biscoitos da sorte. Todas as manhãs, uma pessoa estende a mão e pega um pedaço de papel contendo uma frase que, sem que ela saiba, guiará seu dia. "O que começa como um ritual simples gradualmente se torna uma necessidade diária. Com o tempo, essa prática cria uma dependência emocional", exemplifica.

Assim, a caixa, que a princípio era apenas mais um objeto, torna-se "um oráculo. O que ninguém percebe é que esta caixa não possui nem a sabedoria nem o poder que lhe são atribuídos", explica. Segundo Siles, o algoritmo continua sendo uma linguagem. E, como todas as linguagens, pode reproduzir preconceitos sexistas ou racistas. "Quando falamos da ética da linguagem, precisamos falar também da ética dos algoritmos", acrescenta.

Da América Latina, onde as feridas digitais são agravadas pelas estruturais, Karen Vergara alerta que o problema desse lado do mapa é ainda mais pronunciado. Outro conflito ético que ela observa é a complacência excessiva. Esses modelos de aprendizado de máquina tentam associar perguntas, classificá-las e, com base em todas as informações, fornecer a resposta mais relevante.

No entanto, ignora contextos culturais, misturando informações acadêmicas com frases de autoajuda. "Se nos dissociarmos disso, é mais provável que esses tipos de assistentes virtuais e chatbots acabem reforçando apenas uma maneira de ver o mundo e transmitam a falsa sensação de ser o único amigo que não te julga", enfatiza Vergara.

Siles então retorna à imagem. Ele compara as relações humanas a uma floresta. "Se você observar o que acontece abaixo da superfície e da terra, há uma interconexão, e não podemos quebrá-la; temos que fortalecê-la. Temos que repensar o tipo de sociedade que temos", ressalta.

Regulação, um dilema

Em agosto de 2024, a Europa cruzou um limiar. O Regulamento Europeu sobre Inteligência Artificial entrou em vigor, tornando-se o primeiro marco legal global para a IA. Ele serve como um lembrete aos governos da UE de que a segurança e os direitos fundamentais não são opcionais, mas também um convite para desenvolver um processo de alfabetização. Sua implementação é progressiva e, na Espanha, o anteprojeto recebeu sinal verde em março passado.

Mas o ritmo político nem sempre acompanha a velocidade da tecnologia, e entre aqueles que observam a situação com preocupação está a professora Mercedes Siles, que não esconde sua preocupação. Ela se mostra alarmada com a falta de treinamento, a negligência institucional e o descuido com que algumas empresas implementam modelos sem compreender plenamente suas consequências.

"Como ousamos simplesmente liberar esses sistemas desse jeito, só para ver o que acontece?", ela pergunta. A especialista insiste que as pessoas precisam ser treinadas para entender os limites. Essa visão é compartilhada pelo filósofo Daniel Innerarity, que defende um passo além. Não devemos discutir regulamentações sem antes nos perguntarmos do que realmente estamos falando quando falamos de inteligência artificial.

"Que tipo de futuro nossas tecnologias preditivas estão moldando? O que realmente queremos dizer com inteligência?", ele pergunta. Para a Innerarity, enquanto essas questões básicas não forem resolvidas, qualquer regulamentação corre o risco de ser ineficaz. Ou, pior, arbitrária. "Sem compreensão, os freios não só não funcionam, como nem fazem sentido", conclui.

Leia mais

- “O poder manipula os jovens para usá-los em seu próprio interesse”. Entrevista com Rosa Montero

- ChatGPT: resta-nos habitar um cosmos de solidão. Comentário de Rodrigo Petronio

- A humanidade do humano não se esgota no sapiens. Entrevista especial com Rodrigo Petronio

- Mesologia: uma ontologia em cujo centro está a categoria “relação”. Entrevista especial com Rodrigo Petronio

- Yuval Noah Harari: pensador das eras humanas. Artigo de Rodrigo Petronio

- O algoritmo gosta do discurso de ódio, diz Duvivier: 'A informação pertence a corporações'

- “É o século da solidão”, constata economista inglesa Noreena Hertz

- A era dos coletivos de solidão. Artigo de Boaventura de Sousa Santos

- A solidão na era das novas tecnologias de informação

- 'Redes sociais deixam sociedade mais vulnerável'

- IA possibilita namoro com robôs

- Ferramentas do bem, quando mal usadas, se transformam em problema. Artigo de Edelberto Behs